La clave:

- Xi asiste a una clase magistral sobre inteligencia artificial dentro de la sesión de estudio sobre IA del Politburó

- Lo más sorprendente puede ser la introducción de un nuevo lenguaje relacionado con la gestión de riesgos

El 25 de abril, los observadores del panorama chino de la IA recibieron una importante declaración sobre la postura de Xi Jinping al respecto, en forma de comentarios al concluir una sesión de estudio del Politburó sobre IA, dirigida por el profesor Zheng Nanning de la Universidad de Xi’an Jiaotong. Expresada en el lenguaje pomposo del Partido, la declaración merece, sin embargo, una atención especial, ya que es una de las pocas declaraciones directas del propio Secretario General sobre IA. Para interpretar esta nueva perspectiva, es necesario comprender algunos antecedentes de las sesiones de estudio en general, y de esta en particular.

¿Qué son las sesiones de estudio?

Las sesiones de estudio del Politburó , o 集体学习 (literalmente, «estudio colectivo»), son reuniones periódicas de dos horas de la cúpula directiva del PCCh dedicadas a informarse sobre algún tema considerado prioritario por el Secretario General. Normalmente, la mayor parte de la sesión se dedica a una conferencia impartida por un experto académico en la materia en cuestión, pero ocasionalmente los propios miembros del Politburó realizan presentaciones. Esta estructura fue establecida originalmente por Hu Jintao poco después de su ascenso a Secretario General del PCCh en 2002, y se utilizó para consolidar su poder y promover sus prioridades políticas.

Estas sesiones de estudio son muy diferentes a las horas de oficina de su asistente de enseñanza de pregrado. Los temas reflejan áreas de enfoque clave del líder supremo, que van desde la política exterior hasta la tecnología y temas como » Abriendo nuevas fronteras en la sinización y eraificación del marxismo «. El proceso para organizarlas es extremadamente complejo. Los funcionarios del partido eligen a un experto y trabajan con él para garantizar que la conferencia sea perfecta para las prioridades del líder. Un profesor contratado para retractarse del evangelio del materialismo histórico para el grupo en 2013 dijo que tomó más de tres meses preparar su sesión. Puede haber hasta tres ensayos generales . Las sesiones de estudio generalmente sirven para consolidar y difundir las opiniones del líder sobre algún tema de política en desarrollo, no para realizar talleres o presentar nuevas políticas. Sin embargo, a veces señalan nuevas acciones próximas, ocasionalmente con un efecto drástico. Una sesión de estudio de julio de 2023 sobre » gobernanza de asuntos militares «, por ejemplo, precedió a una ola de purgas del EPL, incluida la destitución de 9 generales en diciembre de 2023 y más en 2024. Los comentarios de los líderes en los comunicados a veces se mencionan en políticas posteriores, como en el caso de las «opiniones orientadoras» sobre blockchain del Ministerio de Industria y Tecnología de la Información en 2021 que citaban una sesión de estudio de 2019.

¿Por qué estudiar IA ahora?

Con tantas otras señales de atención hacia la IA provenientes de Pekín últimamente, no sorprende que Xi quiera que todos estén de acuerdo sobre este tema notoriamente complejo. La última vez que el Politburó tuvo una sesión de estudio sobre IA fue en 2018, dirigida por el profesor de la Universidad de Pekín y académico de la Academia China de Ingeniería, Gao Wen . Esta sesión de estudio siguió a la publicación del emblemático Plan de Desarrollo de IA de Nueva Generación de China en 2017 y presumiblemente sirvió para aclarar cómo debería interpretarse e implementarse dicho plan. Es posible que la sesión de estudio de abril tuviera como objetivo, en parte, informar sobre los nuevos programas de financiación anunciados recientemente.

La respuesta obvia, por supuesto, es Deepseek. Los impresionantes lanzamientos de DeepSeek a finales de 2024 y principios de 2025 catapultaron a la previamente discreta compañía a captar la atención de las altas esferas del PCCh. Si el proceso para organizar una sesión de estudio se inició en enero de 2025, unos meses de preparación nos llevarían exactamente a abril. (Quizás casualmente, la sesión de estudio de la semana pasada también se celebra exactamente dos años y medio después del lanzamiento de ChatGPT en noviembre de 2022, casi el mismo tiempo transcurrido entre la victoria de AlphaGo sobre Lee Sedol en noviembre de 2016 y la última sesión de estudio del Politburó sobre IA en octubre de 2018. Esto da una idea de la velocidad metabólica del sistema del PCCh).

¿Qué dijo Xi al respecto?

Lamentablemente, el Politburó no transmite en directo sus sesiones de estudio por Zoom, ni siquiera comparte las diapositivas después de clase. Sin embargo, tenemos una versión resumida de las palabras de cierre de Xi para la sesión. Dado el papel de las sesiones de estudio en la comunicación de las opiniones del líder, esto es al menos tan importante como el contenido de la propia conferencia.

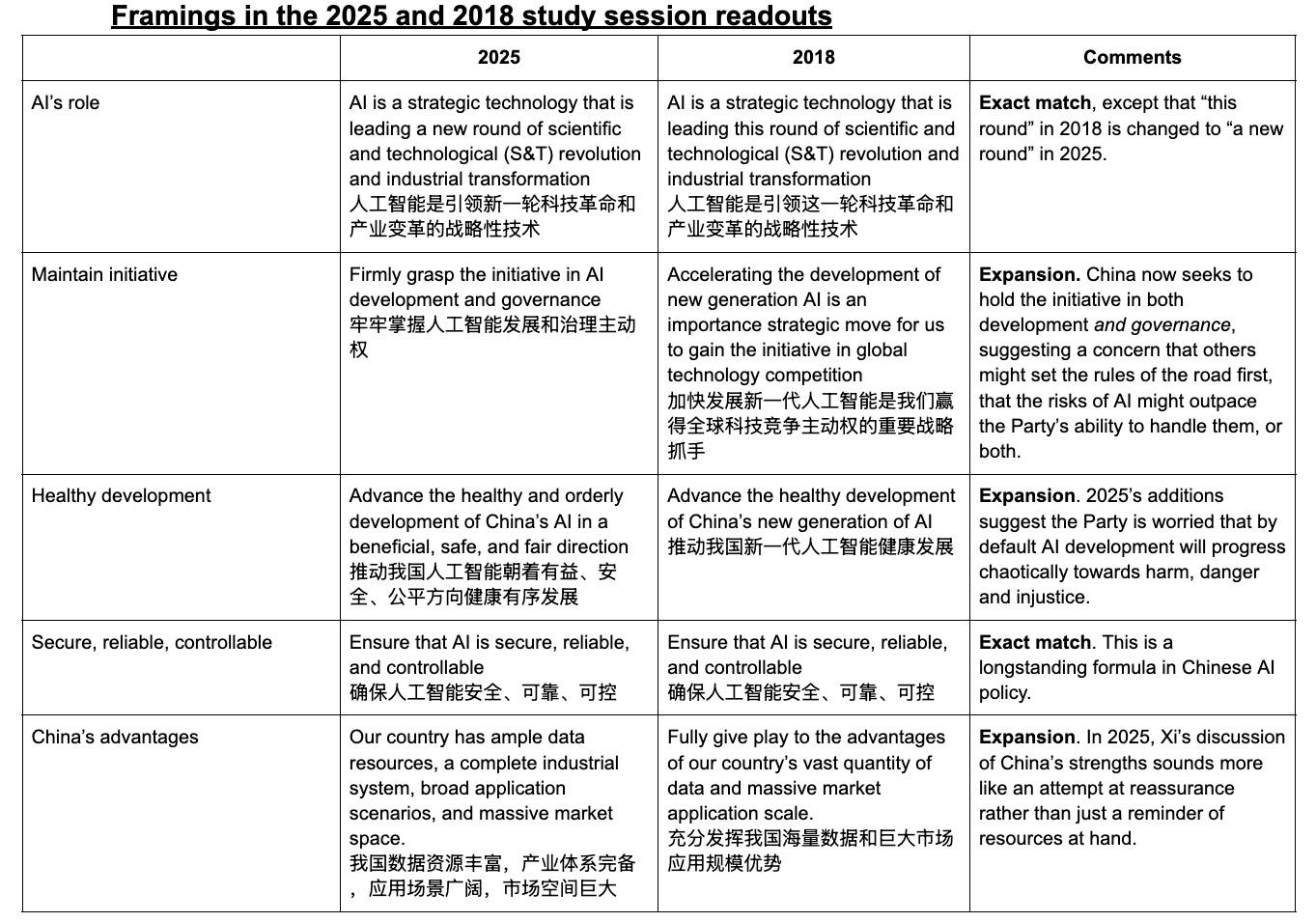

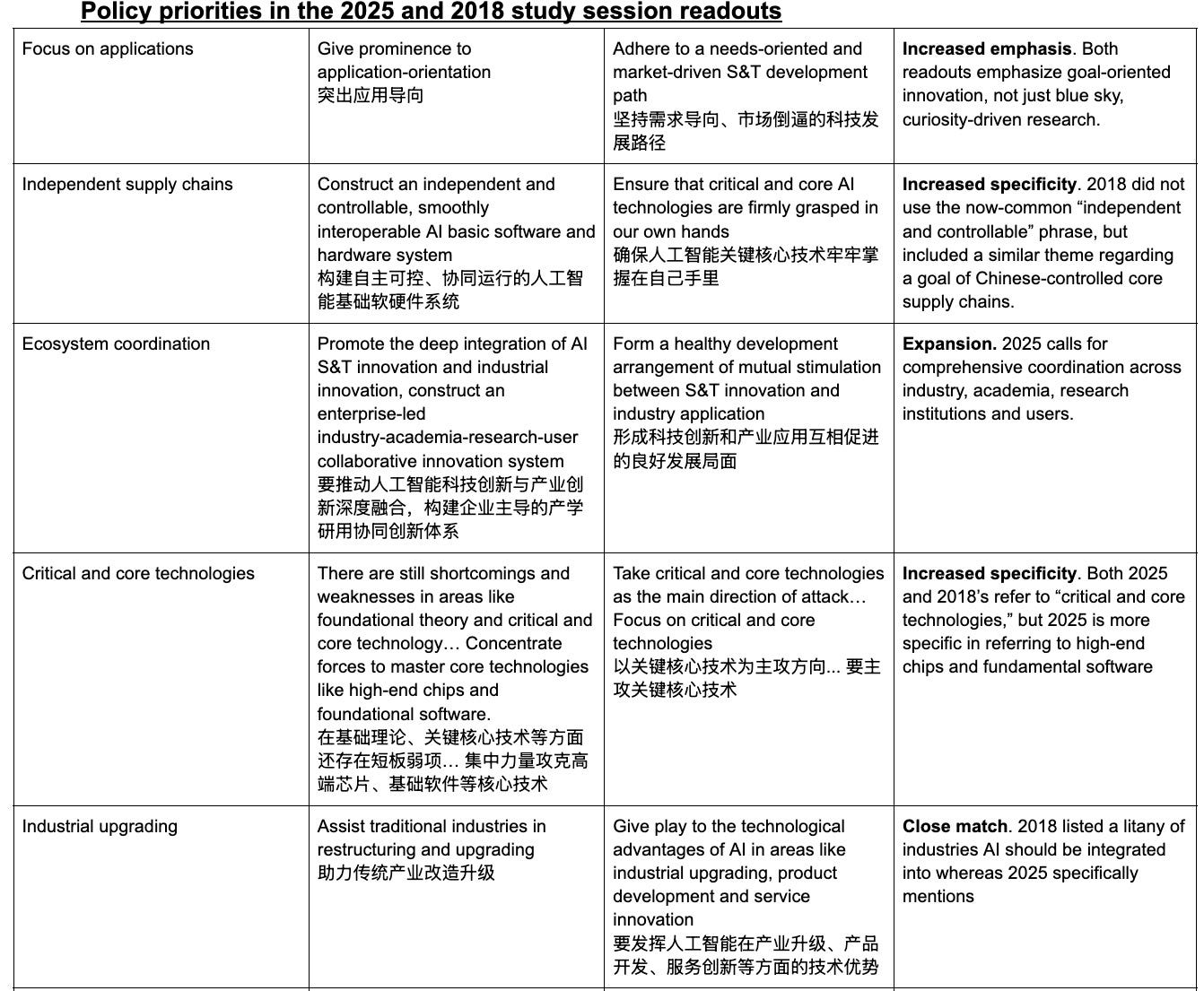

El enfoque de China hacia la IA ha demostrado ser muy consistente desde 2018, por lo que los comentarios de Xi en esta sesión de estudio son muy conocidos. El resumen principal, como se presenta en el primer párrafo, es que China aprovechará las ventajas de su sistema integral para persistir en el autofortalecimiento, con una orientación hacia las aplicaciones, promoviendo un desarrollo sano y ordenado en una dirección beneficiosa, segura y justa. Este autofortalecimiento debe centrarse especialmente en las tecnologías esenciales, avanzadas y fundamentales. En esencia, China mantendrá una política industrial agresiva para autóctonas importantes cadenas de suministro tecnológico, al tiempo que desarrolla valiosas aplicaciones de IA, todo ello sujeto a ciertas restricciones y, por supuesto, a la saludable guía del Partido.

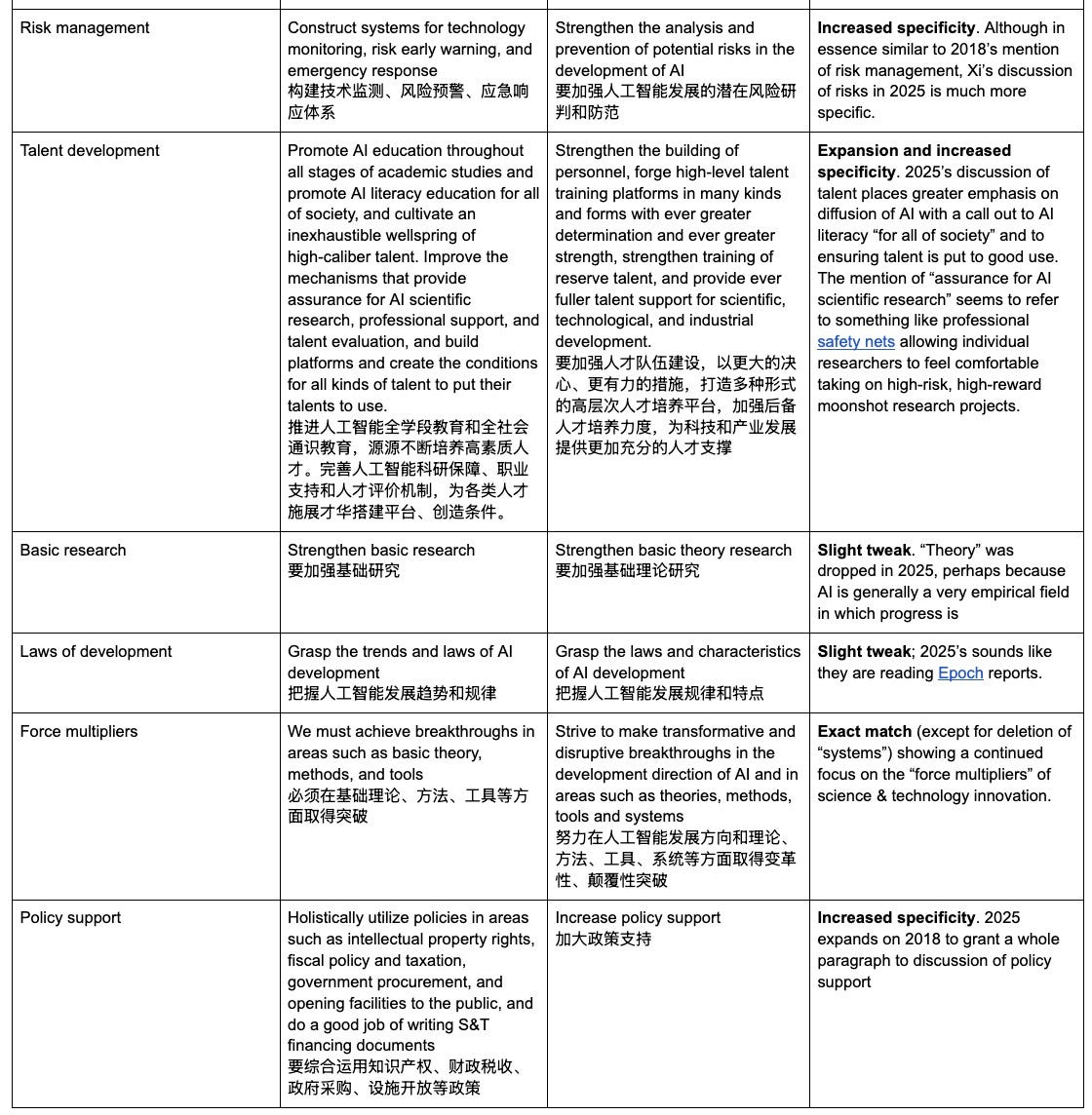

Los temas similares en ambos textos incluyen la preocupación por la debilidad de China en investigación básica y tecnología fundamental, pero también la confianza en sus fortalezas en términos de escala de datos y mercado, el objetivo de integrar adecuadamente la investigación y la industria, y el desarrollo de un ecosistema de talento próspero. Sin embargo, en muchos aspectos, el lenguaje exacto se modifica, a menudo se amplía o se hace más específico.

¡Pero hay novedades! La mención de este año a la «orientación a la aplicación» es similar a la mención de la «orientación a las necesidades» o la «orientación a los problemas» en el informe de 2018, pero ahora ocupa un lugar mucho más destacado, junto con el «autofortalecimiento» en el título y en el resumen de una sola frase del primer párrafo. También parece implicar un mayor enfoque en la difusión de tecnologías ya existentes en lugar de la creación de nuevas, incluso si se trata de «mera» ingeniería en lugar de avances fundamentales, para alcanzar los objetivos nacionales. La lectura de este año también pide específicamente el desarrollo de industrias estratégicas emergentes y futuras (战略性新兴产业和未来产业) y parece hacer un guiño a la » IA para la ciencia » al referirse a «una revolución en el paradigma de la investigación científica liderada por la IA». (以人工智能引领科研范式变革).

Como han señalado los analistas , el análisis de Xi sobre los problemas de seguridad aquí es más progresista que en 2018, o posiblemente cualquier declaración que salga directamente de la boca del líder. Describe los riesgos de la IA como «sin precedentes» y sugiere implementar sistemas de «monitoreo de tecnología, alerta temprana de riesgos y respuesta a emergencias». Esto es mucho más específico que las declaraciones políticas anteriores que llamaban a establecer un » sistema de supervisión y regulación de seguridad de la IA » o a fortalecer la » prevención (de riesgos) prospectiva «. El lenguaje de la lectura de la sesión de estudio casi se asemeja más al de los documentos que circularon en la reciente Cumbre de Acción de IA de París por el nuevo organismo equivalente a AISI de China, la Asociación de Seguridad y Desarrollo de IA de China . Entre una letanía de prioridades para la nueva organización, una de las más ambiciosas se refería a establecer «umbrales de alerta temprana para sistemas de IA que puedan representar riesgos catastróficos o existenciales para los humanos». Es evidente que el pensamiento de expertos en IA preocupados por la seguridad, como el famoso científico informático Andrew Yao y el profesor de Tsinghua Xue Lan, quien ha impartido conferencias en sesiones de estudio en tres ocasiones , la más reciente sobre gestión de emergencias en 2019, está encontrando resonancia en lo más alto de la jerarquía del Partido.

Un componente totalmente novedoso del informe de 2025 es el debate sobre la participación internacional. Si bien es lo suficientemente vago como para ser coherente con la intención de colaborar productivamente con los esfuerzos de Estados Unidos y sus socios en materia de gobernanza de la IA, el enfoque de Xi en el desarrollo de capacidades en el Sur Global y el cierre de la «brecha de inteligencia global» (全球智能鸿沟), así como el llamamiento en otros lugares para «tomar la iniciativa» en la gobernanza, sugiere que esto también se considera, al menos en parte, como una dimensión de la competencia internacional en IA. Podemos imaginar que Xue Lan, en particular, puede haber tomado nota de la descripción de Xi de la IA como un posible » bien público internacional » (国际公共产品) que beneficia a la humanidad. Xue fue el autor principal de un informe que enmarcaba la seguridad de la IA como un «bien público global». El mismo lenguaje apareció posteriormente en una declaración de un grupo que incluía a Xue en el Diálogo Internacional sobre Seguridad de la IA en Venecia, y en un artículo publicado por la Universidad de Oxford que incluía coautores que colaboraban estrechamente con Xue. Aunque parece plausible que el lenguaje de Xi estuviera influenciado por este meme, hay dos diferencias clave aquí.

- Aquí, Xi se refiere a los beneficios del desarrollo de la IA como una bendición para el mundo. Si bien el párrafo menciona el fortalecimiento de la gobernanza y la creación de un marco de gobernanza global, se enmarca en el desarrollo de capacidades en IA. La interpretación más natural es que la idea es garantizar un régimen regulatorio global armonizado para facilitar la difusión y adopción global de la IA china y prevenir las reacciones negativas contra ella. Esto se diferencia de la idea de que la seguridad de la IA es un bien público, ya que mitigar las desventajas de su desarrollo beneficia a todos al reducir los riesgos transnacionales.

- La segunda distinción es más sutil: la visión de Xi de la IA como un bien público es «internacional» (国际) en lugar de «global» (全球), a pesar de la mala traducción de Xinhua en su informe en inglés sobre los comentarios. «Global» implica todo el mundo, tomado como una sola entidad (especialmente en chino, donde la palabra es literalmente 全球quánqíu «globo entero»). «Internacional», por otro lado, simplemente implica algo que ocurre entre naciones, y si sabemos algo sobre las naciones, es que no siempre tratan a todas sus naciones hermanas por igual. En el contexto de un párrafo sobre la difusión de la tecnología de IA en el Sur Global, una lectura cínica es que lo que esto está diciendo es esencialmente: «trabaja con China en IA, obtendrás un buen trato». En el pasado, el gobierno chino ha promovido retóricamente el «código abierto» como un pilar de la cooperación internacional y el desarrollo de capacidades; En este caso, Xi no llega a usar esas palabras exactas, pero el hecho de que los expertos en IA en Indonesia puedan descargar y desarrollar el R1 de DeepSeek podría ser precisamente a lo que se refiere. La conclusión podría no ser tanto que China espere salvar al mundo con, o mucho menos de, la IA, sino que está dispuesta a negociar con externalidades positivas para unir una esfera de influencia en una « comunidad de destino común ».

Ya sea en los años transcurridos desde entonces o durante sus sesiones de estudio, el Partido claramente ha aprendido algunas cosas sobre el desarrollo de la IA.

¿Qué significa todo esto para la IA en China?

Si bien es una declaración política importante, esta sesión de estudio puede o no indicar un cambio significativo en la misma. Como se mencionó anteriormente, las sesiones de estudio suelen ser menos puntos de inflexión que momentos de cristalización. Por lo tanto, es fundamental como evidencia de cosas para las que, de lo contrario, tenemos menos evidencia.

Lo más sorprendente aquí puede ser la sorprendente introducción de un nuevo lenguaje relacionado con la gestión de riesgos. Cabe destacar que los dos expertos que han informado al Politburó sobre IA se han expresado abiertamente sobre los riesgos potenciales, siendo Gao Wen coautor de un documento en 2021 sobre «Contramedidas técnicas para los riesgos de seguridad de la inteligencia artificial general» (aunque es más conocido como director del Laboratorio Peng Cheng , asociado con el ejército, en Shenzhen). No olvidemos la carta personal de Xi Jinping , llena de elogios, a Andrew Yao, un líder clave en el desarrollo del talento STEM de China, pero también uno de los pilares clave del lado chino de los Diálogos Internacionales sobre Seguridad de la IA. Los expertos en IA elegidos por Xi se parecen más a los Yoshua Bengios y Geoffrey Hinton del mundo chino de la IA que a los Yann LeCun. Esto parece un buen augurio para las perspectivas de que China realice esfuerzos razonables para mitigar los riesgos en el desarrollo de la IA a nivel nacional, así como mediante la coordinación internacional. Sin embargo, aparte del establecimiento de la Asociación China de Seguridad y Desarrollo de la IA, un organismo que actualmente parece estar posicionado principalmente como un foro de debate para dialogar con los bárbaros, la mención de «construir un sistema de supervisión y regulación de la seguridad de la IA» en la decisión del Tercer Pleno de julio de 2024 aún no ha dado frutos sustanciales. Si se toman en serio la mitigación de riesgos se decidirá en última instancia con hechos, no con palabras.

En nuestro reciente debate sobre si China está «avanzando rápidamente hacia la IAG», esta sesión de estudio es una continuación de la ambigüedad. Xi definitivamente no señaló ningún énfasis particular en la IAG, y el enfoque en la «orientación a la aplicación» y el desarrollo general del ecosistema contradice cualquier objetivo tecnológico específico y singular para la política de IA de China. Al mismo tiempo, demuestra que la IA es, sin duda, una prioridad absoluta para Xi. La intención de «planificar integralmente» los recursos computacionales y promover el intercambio de datos apunta al tipo de movilización de recursos a escala nacional que probablemente acompañaría un impulso hacia avances en inteligencia general. Y el Partido claramente tiene ideas muy concretas sobre cómo competir en IA. La situación es seria ahora.

Sin embargo, lo que más debería impresionarnos esta sesión de estudio es que los altos mandos del PCCh no solo están pensando en la IA, sino que incluso podrían estar considerando aspectos bastante superficiales como los recursos de datos, las reservas de talento y los indicadores de riesgo. Esta atención puede facilitar la adopción de medidas prudentes para evitar una catástrofe, pero sin duda estimulará la acción para impulsar los objetivos a largo plazo de China de lograr la independencia de la cadena de suministro y avances tecnológicos estratégicos. Su éxito dependerá de la cooperación o la resistencia de millones de ciudadanos chinos con sus propias esperanzas, temores e incertidumbres sobre sus vidas en un mundo con IA, así como de los duros ataques y los torpes descuidos de los competidores geopolíticos de China, y de la ayuda de los socios que puedan reunir.

Pero ¿quién es Zheng Nanning en todo caso?

Los expertos seleccionados para impartir conferencias en sesiones de estudio no son elegidos tanto por aportar algo nuevo, sino por ofrecer exactamente lo que Xi espera. Entonces, ¿cómo sería la representación ideal de las preferencias de Xi en IA?

Zheng Nanning es un académico consumado que se toma muy en serio su rol social. Su experiencia se centra en la visión artificial y el reconocimiento de patrones, pero también se ha involucrado cada vez más en la robótica y la automatización industrial, promoviendo la idea de » inteligencia intuitiva «, centrada en permitir que las IA interactúen con un mundo físico incierto basándose en la comprensión semántica. Si bien no disponemos de las diapositivas de la sesión de estudio del Politburó, sí las tenemos de una charla sobre » Comportamiento de las Máquinas e Inteligencia Encarnada » que Zheng impartió en 2023, con un amplio análisis de la percepción de las máquinas, la robustez, la coordinación humano-IA y otros temas. Académico de la Academia China de Ingeniería, se ha desempeñado como Científico Jefe en el campo de las Ciencias de la Información en el Programa 863, uno de los programas clave de desarrollo tecnológico estratégico de China, miembro del primer Comité Asesor de Expertos para la Informatización Estatal y presidente de su alma máter, la Universidad Xi’an Jiaotong. También ha participado activamente en el desarrollo de talento, liderando la creación de una de las primeras carreras experimentales de pregrado en IA de China.

Un perfil de Zheng del año pasado lo describe como empático y completo: durante un discurso de graduación en el que asume la responsabilidad personal por los fracasos de los estudiantes de último año y los que abandonaron la escuela y no se graduaron a tiempo, citó la novela de mil páginas de Lu Yao, Ordinary World, famosa por representar las luchas y aspiraciones de los chinos rurales comunes durante las décadas de 1970 y 1980. Es una especie de influenciador del fitness, que afirma ser capaz de hacer 50 flexiones de una sola vez y anima a los estudiantes a poner sus corazones en » 50 años de trabajo saludable para la patria «. Aunque puede parecer vergonzoso que su profesor intente que adquiera el hábito de correr, en cambio se lee como conmovedor en el contexto de una reciente oleada de muertes prematuras de líderes de IA de alto perfil en China, que muchos atribuyeron a las intensas presiones del campo. Zheng incluso describe su filosofía educativa como la incorporación del » espíritu de la educación física » al ámbito académico, afirmando que los estudios y la investigación requieren la misma tolerancia a la soledad y la búsqueda constante de avances que el atletismo. Tampoco ignora la importancia de impartir una formación moral a sus alumnos, enfatizando la importancia de inculcarles una fe plena y correcta en los valores socialistas fundamentales del PCCh.

Esta historia personal es muy similar a gran parte del enfoque actual de China en IA: la visión por computadora es clave para el extenso aparato de vigilancia del estado chino y un campo en el que China lidera el mundo tecnológicamente; la «inteligencia incorporada», y especialmente la robótica industrial, es una parte central de la apuesta de China en la IA para producir «modernización industrial» y escapar de la trampa de los ingresos medios, mencionada como una de las cuatro «industrias futuras» prioritarias en las Dos Sesiones de 2025 ; el desarrollo del talento es un pilar fundamental que sustenta los objetivos de China tanto en la investigación básica como en la difusión de la IA en aplicaciones comercialmente valiosas; y mientras Xi busca rediseñar la economía de China hacia una estructura de alta tecnología y alta gama, también está intentando rediseñar la sociedad china hacia la autoconfianza cultural, un mayor atletismo y, como siempre, una alineación íntima y ubicua con el Partido.

Sin embargo, hay una sutil sorpresa en el perfil de Zheng. Aunque asistió a la Universidad Xi’an Jiaotong para su licenciatura y maestría, hizo su doctorado en la Universidad Keio de Japón a principios de la década de 1980. En los últimos años, la experiencia educativa en el extranjero ha pasado de ser un activo codiciado en el panorama profesional chino a posiblemente una desventaja, especialmente para puestos en el gobierno. En la China cada vez más nacionalista de Xi, una historia de inmersión en culturas occidentales sugiere una posible corrupción espiritual. (En un resumen de la sesión de estudio, un bloguero chino se refirió en broma a los comentarios recientes de la presidenta del fabricante de electrodomésticos Gree Electric de que se niega a contratar a esos «retornados», ya que hay «espías entre ellos»). No deberíamos leer demasiado en esto, ya que la educación en Japón era muy común para el grupo de Zheng y, en general, se considera menos problemática que la educación en los EE. UU. Sin embargo, si los organizadores del Partido hubieran querido elegir a alguien con formación únicamente nacional y al menos tan impresionante como Zheng, probablemente lo habrían hecho con facilidad. Bajo el gobierno de Xi, los conferenciantes de las sesiones de estudio han venido cada vez más no del ámbito académico, sino del propio sistema de partido-estado. Es posible que, al igual que la inclusión de un aparente extranjero en la audiencia de la reciente visita de Xi a un centro de IA en Shanghái, esta débil señal de respaldo al intercambio internacional fuera, aunque no buscada activamente, al menos pasivamente bienvenida para comunicar una actitud ligeramente más abierta hacia el talento extranjero y formado en el extranjero en IA. Con la administración Trump provocando que cualquier persona con visa en Estados Unidos tenga una nueva cana a diario, China sin duda debe reconocer la oportunidad de recuperar el talento STEM de la diáspora, y potencialmente incluso algunos de terceros países.

Zheng también tiene una larga historia de dar comentarios sobre IA y sociedad que parecen estar en estrecha sintonía con el enfoque de Xi hacia la IA. Ya en 2016 hablaba sobre la necesidad de perseguir tanto la investigación básica como el desarrollo impulsado por aplicaciones como «agarrar con ambas manos». Ha discutido en detalle el dilema inherente a este enfoque doble, donde la fuerte presión para producir trabajo científico puede llevar a que los investigadores se sientan » como hormigas en un wok caliente » y elijan proyectos menos ambiciosos como resultado. En línea con el enfoque de Xi en atender tanto a la seguridad como al desarrollo, ha advertido que la IA es un arma de doble filo , señalando que la tecnología se ha utilizado en el pasado para «obstaculizar el desarrollo social e incluso causar desastres para la humanidad». Como académico integral, ha señalado la necesidad de contribuciones interdisciplinarias de las humanidades, la filosofía y el derecho para abordar los riesgos de la IA. Él traza un camino intermedio, lamentablemente poco común incluso en el ecosistema de IA occidental, al pedir a los científicos que no se dejen llevar por la propaganda ni difundan proyectos poco realistas con respecto a la IA, ni que se involucren en cambiar los objetivos o minimizar los avances.

¿Qué ve Zheng para el futuro de la IA? Desde al menos 2016 y tan recientemente como 2021 , ha descrito el campo como un campo que enfrenta tres desafíos principales. El primero es hacer que las máquinas «aprendan sin maestros». Podría decirse que esto ya se ha logrado mediante los LLM, preentrenados en conjuntos de datos masivos mediante aprendizaje no supervisado y capaces de un aprendizaje en contexto impresionantemente amplio con solo indicaciones. El segundo es hacer que las máquinas perciban y comprendan el mundo como lo hacen los humanos. No está claro qué implicaría exactamente esto, pero es difícil sentir que no estemos en camino hacia eso con, por ejemplo, sistemas de IA que puedan distinguir cualquier objeto arbitrario en cualquier escena. El desafío final, en el relato de Zheng, es dotar a las máquinas de «autoconciencia, emociones y la capacidad de reflexionar sobre sus situaciones y comportamientos». Esperemos que los investigadores de IA reflexivos como Zheng reflexionen sobre los complejos riesgos y las preguntas filosóficas que la conciencia situacional y la sensibilidad de la IA pueden plantear antes de que el filo equivocado de la espada corte.

Fuente: Jordan Schneider– ChinaTalk

Foto: anne-nygard-unsplash

ES

ES EN

EN EU

EU